Techniczne SEO to kluczowy element strategii widoczności każdej strony internetowej, który często bywa niedoceniany. Skupia się ono na optymalizacji infrastruktury witryny, aby zapewnić jej jak najlepsze zrozumienie przez roboty wyszukiwarek i zagwarantować płynne doświadczenia użytkownikom. W tym artykule przeprowadzimy Cię przez najważniejsze aspekty technicznego SEO, od podstawowych zasad indeksowania po zaawansowane techniki, dostarczając praktycznych wskazówek i narzędzi, które pomogą Ci samodzielnie zdiagnozować i poprawić kondycję Twojej witryny.

Czym jest techniczne SEO i dlaczego jest fundamentem Twojej widoczności w Google?

Techniczne SEO bez tajemnic: Co kryje się za "zapleczem" Twojej strony?

Techniczne SEO to zbiór działań optymalizacyjnych skupionych na infrastrukturze strony internetowej, które mają na celu ułatwienie jej indeksowania i zrozumienia przez roboty wyszukiwarek oraz zapewnienie jak najlepszych doświadczeń użytkownikom (UX). Można powiedzieć, że to właśnie to "zaplecze" strony decyduje o tym, jak dobrze jest ona postrzegana przez algorytmy wyszukiwarek, zanim jeszcze zaczniemy mówić o samej treści.

On-page, off-page a techniczne SEO: Zrozumienie trzech filarów pozycjonowania

W pozycjonowaniu stron internetowych wyróżniamy trzy główne filary: on-page SEO, off-page SEO oraz techniczne SEO. On-page SEO dotyczy optymalizacji treści i elementów bezpośrednio na stronie, takich jak słowa kluczowe, nagłówki czy meta opisy. Off-page SEO skupia się na działaniach poza witryną, przede wszystkim na budowaniu profilu linków zwrotnych i wzmacnianiu autorytetu domeny. Techniczne SEO stanowi jednak fundament dla pozostałych działań SEO. Bez solidnych podstaw technicznych, nawet najbardziej wartościowa treść i mocne linki mogą nie wystarczyć, aby osiągnąć satysfakcjonujące wyniki w wyszukiwarkach.

Konsekwencje zaniedbań technicznych: Co ryzykujesz, ignorując ten aspekt?

Zaniedbania w obszarze technicznym mogą mieć bardzo poważne konsekwencje dla widoczności Twojej strony. Problemy z indeksowaniem sprawiają, że roboty wyszukiwarek nie mogą prawidłowo zeskanować i ocenić Twojej witryny, co prowadzi do jej słabej widoczności w wynikach wyszukiwania. Powolne ładowanie strony frustruje użytkowników i zniechęca ich do dalszego przeglądania, co negatywnie wpływa na współczynniki odrzuceń i czas spędzony na stronie. W skrajnych przypadkach, nawet najlepsza treść może nie osiągnąć wysokich pozycji, jeśli strona ma problemy techniczne, a nawet może nie pojawić się w ogóle w wynikach wyszukiwania.

Fundament nr 1: Dostępność dla robotów – jak upewnić się, że Google Cię widzi?

Plik robots.txt: Jak skutecznie komunikować się z robotami wyszukiwarek?

Plik `robots.txt` to prosty plik tekstowy umieszczany w głównym katalogu strony internetowej, który działa jak zestaw instrukcji dla robotów wyszukiwarek. Za jego pomocą możemy wskazać, które sekcje strony roboty mogą skanować, a do których nie powinny mieć dostępu. Jest to niezwykle przydatne narzędzie do zarządzania tym, jak wyszukiwarki indeksują Twoją witrynę. Możemy go użyć na przykład do zablokowania dostępu do panelu administracyjnego, plików tymczasowych czy stron z treściami, które nie powinny być widoczne w wynikach wyszukiwania.

Mapa witryny sitemap.xml: Stwórz przewodnik po swojej stronie dla Google

Mapa witryny w formacie `sitemap.xml` jest niczym szczegółowy przewodnik po Twojej stronie dla robotów wyszukiwarek. Zawiera listę wszystkich podstron, które chcesz, aby zostały zaindeksowane. Jest to szczególnie ważne dla dużych, rozbudowanych witryn, gdzie roboty mogą mieć trudność z odnalezieniem wszystkich podstron poprzez samą nawigację. Regularne aktualizowanie i przesyłanie `sitemap.xml` do Google Search Console pomaga wyszukiwarkom szybciej odkrywać nowe treści i zapewniać ich poprawną indeksację.

Budżet indeksowania (Crawl Budget): Co to jest i jak nim mądrze zarządzać?

Budżet indeksowania, czyli crawl budget, to limit liczby stron, które robot wyszukiwarki jest w stanie i chce odwiedzić oraz zaindeksować na Twojej stronie w określonym czasie. Dla dużych serwisów internetowych, gdzie mamy do czynienia z tysiącami, a nawet milionami podstron, efektywne zarządzanie tym budżetem jest kluczowe. Pozwala to upewnić się, że roboty skupiają się na indeksowaniu najważniejszych i najbardziej wartościowych dla użytkownika treści, zamiast marnować zasoby na strony nieistotne, zduplikowane lub błędy. Zarządzanie nim polega między innymi na blokowaniu dostępu do niepotrzebnych sekcji w `robots.txt` czy eliminacji duplikatów.

Najczęstsze błędy indeksacji i jak je naprawić (noindex, błędy serwera, blokady)

- Strony z meta tagiem `noindex`: Oznaczają one, że strona nie powinna być indeksowana przez wyszukiwarki. Należy je usuwać ze stron, które chcemy widzieć w wynikach wyszukiwania.

- Błędy serwera (np. 5xx): Wskazują na problemy z działaniem serwera hostingowego. Wymagają pilnej interwencji administratora serwera lub dostawcy hostingu.

- Blokady w pliku `robots.txt`: Mogą uniemożliwić robotom dostęp do ważnych części strony, jeśli są nieprawidłowo skonfigurowane.

- Problemy z dostępnością URL: Nieprawidłowe przekierowania, błędy 404 na stronach, do których prowadzą linki wewnętrzne, czy zbyt długie czasy ładowania mogą utrudniać indeksację.

Fundament nr 2: Szybkość i wydajność – dlaczego Core Web Vitals to Twój sprzymierzeniec?

LCP, INP, CLS: Co oznaczają te wskaźniki i jak wpływają na Twoją pozycję?

Core Web Vitals to zestaw kluczowych wskaźników wydajności strony, które Google wykorzystuje do oceny doświadczenia użytkownika. LCP (Largest Contentful Paint) mierzy czas ładowania największego elementu treści widocznego w oknie przeglądarki im krótszy, tym lepiej. INP (Interaction to Next Paint) ocenia responsywność strony na interakcje użytkownika, mierząc opóźnienie między akcją użytkownika a reakcją strony niski INP oznacza szybką odpowiedź. CLS (Cumulative Layout Shift) monitoruje stabilność wizualną strony, czyli jak często elementy na stronie przesuwają się w trakcie ładowania, co może być bardzo irytujące dla użytkownika. Wszystkie te wskaźniki mają bezpośredni wpływ na pozycję strony w wynikach wyszukiwania oraz na ogólne zadowolenie odwiedzających.

Praktyczne metody na przyspieszenie strony: Optymalizacja obrazów, kodu i serwera

Poprawa szybkości ładowania strony to proces, który obejmuje wiele działań. Kluczowe z nich to:- Optymalizacja obrazów: Kompresja plików graficznych bez utraty jakości, wybór odpowiedniego formatu (np. WebP) i stosowanie leniwego ładowania (lazy loading) znacząco redukuje czas ładowania.

- Minifikacja kodu: Usunięcie zbędnych znaków (białych znaków, komentarzy) z plików CSS, JavaScript i HTML zmniejsza ich rozmiar.

- Wykorzystanie pamięci podręcznej przeglądarki: Pozwala to na szybsze ładowanie strony dla powracających użytkowników, ponieważ przeglądarka nie musi pobierać wszystkich zasobów od nowa.

- Wdrożenie sieci dostarczania treści (CDN): CDN rozkłada zasoby strony na serwerach rozmieszczonych globalnie, co skraca czas dostępu dla użytkowników z różnych lokalizacji.

- Kompresja Gzip: Zmniejsza rozmiar plików przesyłanych z serwera do przeglądarki.

- Wybór szybkiego hostingu: Wydajny serwer hostingowy to podstawa szybkiej strony.

Narzędzia do mierzenia prędkości: Jak samodzielnie sprawdzić wydajność witryny?

- Google PageSpeed Insights: Dostarcza analizy wydajności strony na urządzeniach mobilnych i stacjonarnych oraz sugeruje konkretne usprawnienia.

- Lighthouse: Narzędzie zintegrowane z przeglądarką Chrome, które analizuje nie tylko wydajność, ale także dostępność, najlepsze praktyki i SEO.

- GTmetrix: Popularne narzędzie oferujące szczegółowe raporty dotyczące szybkości ładowania, wydajności i problemów zoptymalizacją.

Fundament nr 3: Architektura i doświadczenie użytkownika (UX) – zbuduj stronę, którą pokochają ludzie i roboty

Struktura adresów URL: Jak tworzyć proste i przyjazne SEO adresy?

Logiczna i przejrzysta struktura adresów URL jest niezwykle ważna zarówno dla użytkowników, jak i dla robotów wyszukiwarek. Przyjazne adresy URL powinny być krótkie, opisowe i zawierać słowa kluczowe, które jasno komunikują zawartość danej podstrony. Unikaj długich ciągów znaków, numerów sesji czy niepotrzebnych parametrów. Stosuj myślniki do oddzielania słów, zamiast podkreśleń. Dobrym przykładem jest `twojadomena.pl/uslugi/seo-techniczne`, a nie `twojadomena.pl/index.php?id=123&cat=4&sub=seo`.

Linkowanie wewnętrzne: Jak stworzyć logiczną sieć połączeń na stronie?

Linkowanie wewnętrzne to proces tworzenia połączeń między różnymi podstronami w obrębie Twojej witryny. Jest to kluczowe dla nawigacji użytkowników, pomagając im łatwo poruszać się po stronie i odkrywać powiązane treści. Równie ważne jest dla robotów wyszukiwarek, ponieważ pomaga im w odkrywaniu nowych podstron i zrozumieniu ich relacji. Ponadto, linkowanie wewnętrzne pozwala na dystrybucję "mocy" SEO (tzw. link juice) pomiędzy podstronami, wzmacniając te, które są dla Ciebie najważniejsze. Staraj się tworzyć kontekstowe linki, które kierują do powiązanych tematycznie treści, oraz dbaj o to, aby najważniejsze podstrony były łatwo dostępne z poziomu menu lub linków wewnętrznych.Mobile-First Indexing w praktyce: Upewnij się, że Twoja strona jest gotowa na mobilną rewolucję

W dzisiejszych czasach większość użytkowników przegląda internet za pomocą urządzeń mobilnych. W odpowiedzi na ten trend, Google wprowadziło tzw. Mobile-First Indexing, co oznacza, że algorytmy wyszukiwarki analizują i indeksują przede wszystkim wersję mobilną strony internetowej. Dlatego tak ważne jest, aby Twoja witryna była w pełni responsywna, czyli poprawnie wyświetlała się i działała na smartfonach i tabletach. Oznacza to nie tylko odpowiednie skalowanie elementów, ale także zapewnienie łatwej nawigacji i czytelności treści na mniejszych ekranach.

Certyfikat SSL (HTTPS): Dlaczego bezpieczeństwo to dziś absolutna konieczność?

Bezpieczeństwo strony internetowej stało się jednym z podstawowych wymogów, a protokół HTTPS (z certyfikatem SSL) jest tego kluczowym elementem. Jest to oficjalny czynnik rankingowy, który nie tylko szyfruje połączenie między użytkownikiem a serwerem, chroniąc przesyłane dane, ale także buduje zaufanie odwiedzających. Przeglądarki internetowe coraz częściej oznaczają strony bez HTTPS jako "niebezpieczne", co może odstraszyć potencjalnych klientów. Wdrożenie certyfikatu SSL jest dziś standardem, który powinieneś zapewnić na każdej stronie.

Zaawansowane techniki SEO: Jak zyskać przewagę nad konkurencją?

Dane strukturalne (Schema.org): "Mów" w języku Google, aby zdobyć rozszerzone wyniki

Dane strukturalne, oparte na standardzie Schema.org, to specjalne znaczniki dodawane do kodu HTML strony, które pomagają wyszukiwarkom lepiej zrozumieć kontekst treści. Dzięki nim roboty mogą zidentyfikować, czy dana strona zawiera przepis, wydarzenie, produkt, opinię czy osobę. Implementacja danych strukturalnych może prowadzić do wyświetlania rozszerzonych wyników w wyszukiwarce (tzw. rich snippets), które są bardziej widoczne i atrakcyjne dla użytkowników, co znacząco zwiększa współczynnik klikalności (CTR). Co więcej, dane strukturalne ułatwiają sztucznej inteligencji rozumienie treści, zwiększając szanse na pojawienie się w odpowiedziach generowanych przez AI.

Problem zduplikowanej treści: Jak go zdiagnozować i rozwiązać za pomocą tagów kanonicznych?

Zduplikowana treść występuje, gdy ta sama lub bardzo podobna treść jest dostępna pod różnymi adresami URL. Może to być spowodowane np. wersjami strony z `www` i bez `www`, wersjami http i https, czy parametrami URL. Taka sytuacja może wprowadzać w błąd roboty wyszukiwarek i prowadzić do rozproszenia "mocy" SEO, co negatywnie wpływa na rankingi. Aby temu zapobiec, stosuje się tagi kanoniczne (`rel="canonical"`). Pozwalają one wskazać wyszukiwarkom, która wersja strony jest tą preferowaną i powinna być indeksowana. Ten proces nazywamy kanonikalizacją.

Znaczniki Hreflang: Niezbędnik dla stron wielojęzycznych

Jeśli Twoja strona jest skierowana do odbiorców z różnych krajów i dostępna w wielu wersjach językowych, znaczniki `hreflang` są dla Ciebie absolutnie niezbędne. Pomagają one wyszukiwarkom, w tym Google, zrozumieć, które wersje językowe strony są przeznaczone dla konkretnych regionów. Dzięki temu użytkownikom z danego kraju lub posługującym się danym językiem zostanie wyświetlona najbardziej odpowiednia wersja językowa Twojej witryny, co znacząco poprawia doświadczenie użytkownika i może wpłynąć na lepsze pozycjonowanie w lokalnych wynikach wyszukiwania.

Obsługa błędów 404 i przekierowań 301: Jak zarządzać nieistniejącymi stronami?

Poprawne zarządzanie błędami i przekierowaniami jest kluczowe dla utrzymania dobrej kondycji technicznej strony. Błąd 404 "Nie znaleziono strony" pojawia się, gdy użytkownik próbuje wejść na adres, który nie istnieje. Zamiast wyświetlać pustą stronę błędu, warto stworzyć dedykowaną stronę 404, która kieruje użytkownika do innych, wartościowych zasobów na stronie. Kiedy strona zostaje przeniesiona na nowy adres lub usunięta, należy zastosować przekierowanie 301 (trwałe), aby przekierować ruch i "moc" SEO ze starego adresu na nowy. Przekierowania 302 (tymczasowe) stosuje się w rzadszych przypadkach, gdy zmiana adresu jest chwilowa.

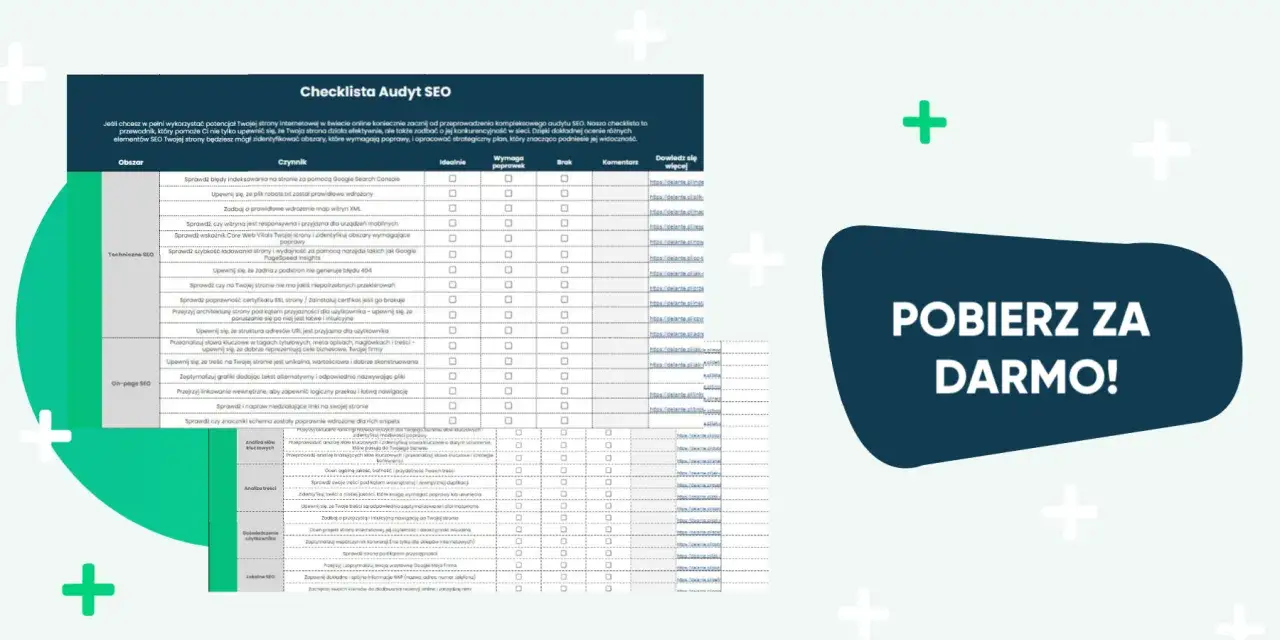

Praktyczny audyt techniczny SEO: Twoja lista kontrolna krok po kroku

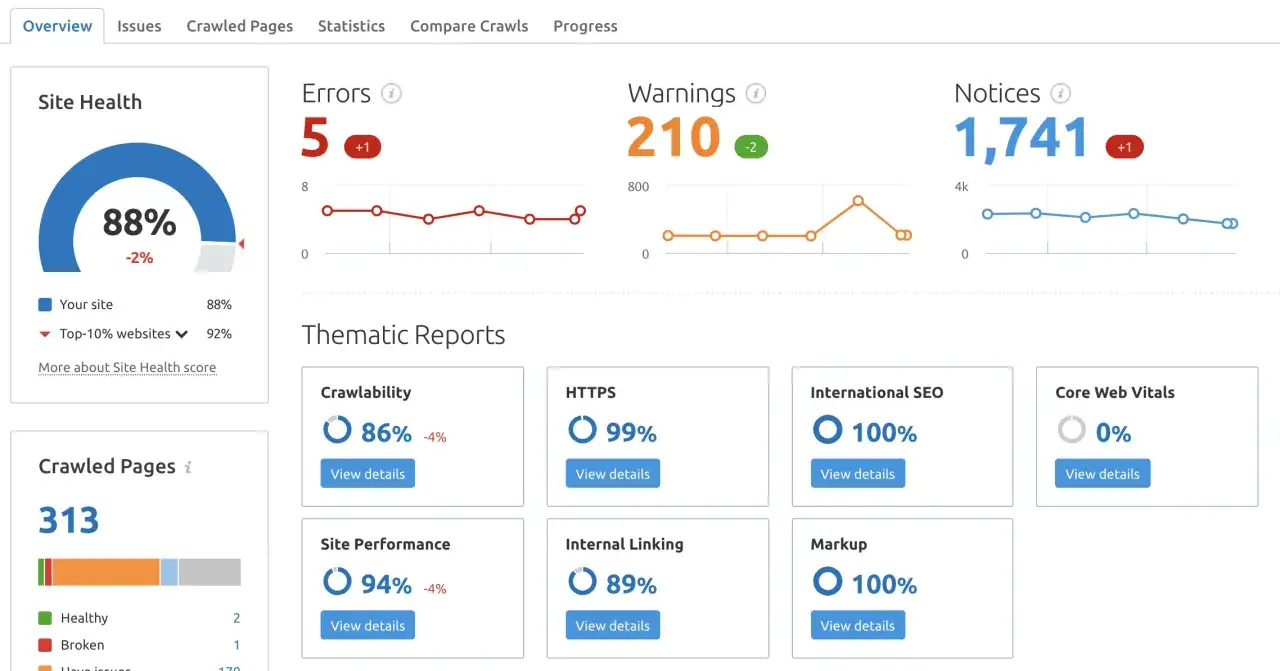

Niezbędne narzędzia audytowe: Przegląd darmowych i płatnych opcji

- Google Search Console: Podstawowe, darmowe narzędzie od Google, które dostarcza informacji o stanie indeksowania, błędach, wydajności i bezpieczeństwie strony.

- Screaming Frog SEO Spider: Potężne narzędzie desktopowe (z darmową wersją ograniczoną do 500 URL-i), które skanuje witrynę i identyfikuje problemy techniczne, takie jak błędy 404, przekierowania, duplikaty treści czy problemy z meta tagami.

- GTmetrix: Narzędzie do analizy szybkości ładowania strony, które dostarcza szczegółowych raportów i rekomendacji optymalizacyjnych.

- Ahrefs Site Audit: Część większego pakietu narzędzi SEO, oferuje kompleksowy audyt techniczny z wieloma funkcjami.

- Semrush Site Audit: Podobnie jak Ahrefs, Semrush oferuje zaawansowane narzędzie do audytu technicznego, integrujące się z innymi funkcjami platformy.

Checklista audytowa: Kluczowe elementy do sprawdzenia na każdej stronie

- Dostępność `robots.txt` i `sitemap.xml`: Upewnij się, że pliki istnieją, są poprawnie skonfigurowane i dostępne dla robotów.

- Status indeksowania w GSC: Sprawdź raporty indeksowania w Google Search Console, aby zidentyfikować strony zablokowane lub z błędami.

- Szybkość ładowania (Core Web Vitals): Przeanalizuj LCP, INP i CLS za pomocą PageSpeed Insights lub Lighthouse.

- Responsywność mobilna: Zweryfikuj, czy strona poprawnie wyświetla się na urządzeniach mobilnych.

- Certyfikat SSL: Upewnij się, że strona działa na protokole HTTPS i certyfikat jest ważny.

- Struktura URL i linkowanie wewnętrzne: Sprawdź, czy adresy URL są logiczne, a linkowanie wewnętrzne jest spójne i efektywne.

- Obsługa błędów 404 i przekierowań: Zidentyfikuj i napraw błędy 404 oraz upewnij się, że przekierowania 301 są prawidłowo skonfigurowane.

- Duplikacja treści i tagi kanoniczne: Zlokalizuj potencjalne problemy z duplikacją i zastosuj tagi `rel="canonical"`.

- Dane strukturalne: Zweryfikuj poprawność implementacji danych strukturalnych.

Jak interpretować dane z Google Search Console w kontekście technicznym?

Google Search Console to nieocenione źródło informacji o technicznym stanie Twojej witryny. Raport "Stan indeksowania" pozwala zidentyfikować, które strony są zaindeksowane, a które mają problemy, wskazując przyczyny (np. błędy serwera, blokady `robots.txt`, tag `noindex`). Sekcja "Podstawowe wskaźniki internetowe" dostarcza danych o Core Web Vitals, pomagając ocenić doświadczenie użytkownika pod kątem szybkości i stabilności. Raport "Użyteczność na urządzeniach mobilnych" informuje o błędach związanych z wyświetlaniem strony na smartfonach. Analiza raportów "Błędy" (np. 404) oraz "Rozszerzone wyniki" (dotyczące danych strukturalnych) pozwala na bieżąco monitorować i naprawiać kluczowe aspekty techniczne.

Przyszłość technicznego SEO: Na jakie trendy i wyzwania warto się przygotować?

Wpływ sztucznej inteligencji (AI) na wymagania techniczne wyszukiwarek

Rozwój sztucznej inteligencji (AI) rewolucjonizuje sposób, w jaki wyszukiwarki rozumieją i oceniają strony internetowe. Algorytmy AI stają się coraz bardziej zaawansowane w interpretacji kontekstu i intencji użytkownika. Oznacza to, że techniczne SEO musi ewoluować, aby wspierać te zmiany. Na przykład, dane strukturalne stają się jeszcze ważniejsze, ponieważ ułatwiają AI szybkie i precyzyjne zrozumienie treści. Strony z dobrze zoptymalizowaną, przejrzystą strukturą techniczną, która ułatwia AI analizę, będą miały większą szansę na sukces w przyszłości.

Przeczytaj również: Monitoring pozycji w Google - Jak skutecznie śledzić i działać?

Ciągły monitoring: Dlaczego techniczne SEO to proces, a nie jednorazowe zadanie?

Algorytmy wyszukiwarek stale się zmieniają, a technologie internetowe ewoluują. Dlatego techniczne SEO nie jest jednorazowym zadaniem, ale ciągłym procesem. Regularne monitorowanie kondycji technicznej strony, przeprowadzanie okresowych audytów i szybkie reagowanie na pojawiające się problemy są kluczowe dla utrzymania i poprawy widoczności w wynikach wyszukiwania. Zaniedbanie tego aspektu może szybko doprowadzić do utraty wypracowanych pozycji i spadku ruchu na stronie. Ciągłe doskonalenie technicznych aspektów witryny to inwestycja w jej długoterminowy sukces.